Де використовують Computer Vision

Від маски в FaceApp до автопрому

Комп’ютери — вже не замкнута електронна система. Вони взаємодіють із зовнішнім світом. Наприклад, «бачать» об’єкти й відрізняють їх один від одного.

Фіксація порушників ПДР на камери, трансляція зображення дронами та навіть маски з ефектом старіння в FaceApp — усе це застосування комп’ютерного зору. Розповідаємо, як Computer Vision використовують у розробці автопілотів, промисловості, ритейлі та спорті.

Взаємодія зі світом

До початку 1980-х більшість завдань, які доручали комп’ютерам, належала до обчислень або моделювання. Ніщо ззовні не впливало на роботу, а результати залишалися в межах систем.

Нині комп’ютери навчилися розв’язувати конкретні задачі, управлятися з внутрішніми алгоритмами та почали взаємодіяти зі світом. Computer Vision (комп’ютерний зір) вчить машини розуміти й бачити об’єкти ззовні.

Завдання, які розв’язує Computer Vision, можна розділити на прості та складні. Прості — це, наприклад, визначення класу об’єкта на зображенні. Спочатку пристрої отримують графічну інформацію з камер або баз фотографій. За допомогою бібліотек (наприклад, OpenCV) пікселі картинок декодують. Це дає змогу сегментувати фото, визначати межі об’єктів або обличчя. Такі операції називають «низькорівневим» зором.

Складніше завдання — верифікація предметів або облич у реальному часі. Наприклад, ідентифікація конкретної людини на відео. Нейромережі вчаться розпізнавати потрібний об’єкт або зіставляти його зі зразком, аналізуючи мільйони зображень.

Автопілоти й промислові роботи

Машинний зір — це інженерне застосування технологій комп’ютерного зору на виробництві. Уперше Machine Vision впровадила американська компанія Automatix. У 1980 році вона реалізувала виробництво мікросхем без участі людини.

На заводі машинний зір використовують на етапі складання або роботи із сировиною. Камери встановлюють, щоб отримати зображення деталей, а програмне забезпечення аналізує ситуацію. Так, наприклад, можуть перевіряти якість збірки на автомобільних конвеєрах. Машинний зір дає змогу відбирати бракований товар або повідомляти про розташування деталей.

Комп’ютерний зір — основа всіх систем автопілотів. Найкращий приклад — автопілот Tesla. Програмувати комп’ютерний зір для відкритого середовища набагато складніше, ніж створювати промислових роботів: на виробництві менше факторів, які не можна спрогнозувати. На відкритому просторі занадто багато непередбачуваних параметрів (поведінка людей, погода, тварини, особливості ландшафту).

Автопілотом Tesla займаються 48 окремих нейромереж, які під час навчання обробили 70 000 годин графіки. Нейромережі навчаються на різних сценаріях і видають тисячі прогнозів.

Але навіть якщо завантажити в нейромережу повний обсяг доступних даних, передбачити все неможливо. Іронія в тому, що людина не знає, що їй невідомо, і, отже, не може показати це машині.

Андрій Карпатий, директор Tesla з розробки технологій комп’ютерного зору та ШІ, який також створював програмне забезпечення для автопілота, ілюстрував це так: уявіть вантажівку, яка перевозить вантажівку, що везе вантажівку, яка везе ще одну вантажівку. Карпатий зазначив, що раніше він та інші розробники не знали, що такі ситуації на дорозі (як і багато інших) дійсно відбуваються. Відтак вони не мали змоги навчити автопілот реагувати на всі фактори.

Але в Tesla знайшли спосіб постійно вдосконалювати автопілот. Маршрути власників автомобілів записують і завантажують у базу. У компанії зазначають, що отримують дані в режимі реального часу з 1 млн машин.

Персональний тренер, ідеальний сендвіч та пазли для археологів

Комп’ютерний зір використовують і для простих побутових завдань. Так, у 2019 році Amazon випустив застосунок StyleSnap, який називають «шазамом для одягу». Він обробляє фото одягу, завантажене користувачем, і шукає подібні речі в магазині Amazon.

Ще одне рішення впровадили в супермаркетах Amazon Go, де немає касирів. Щоб увійти, потрібно відсканувати QR-код. Магазин визначає, що купують люди, за допомогою застосунку Just walk out. Аналізуючи записи з камер, застосунок впізнає товар, який взяв покупець, і автоматично списує гроші з його банківської картки.

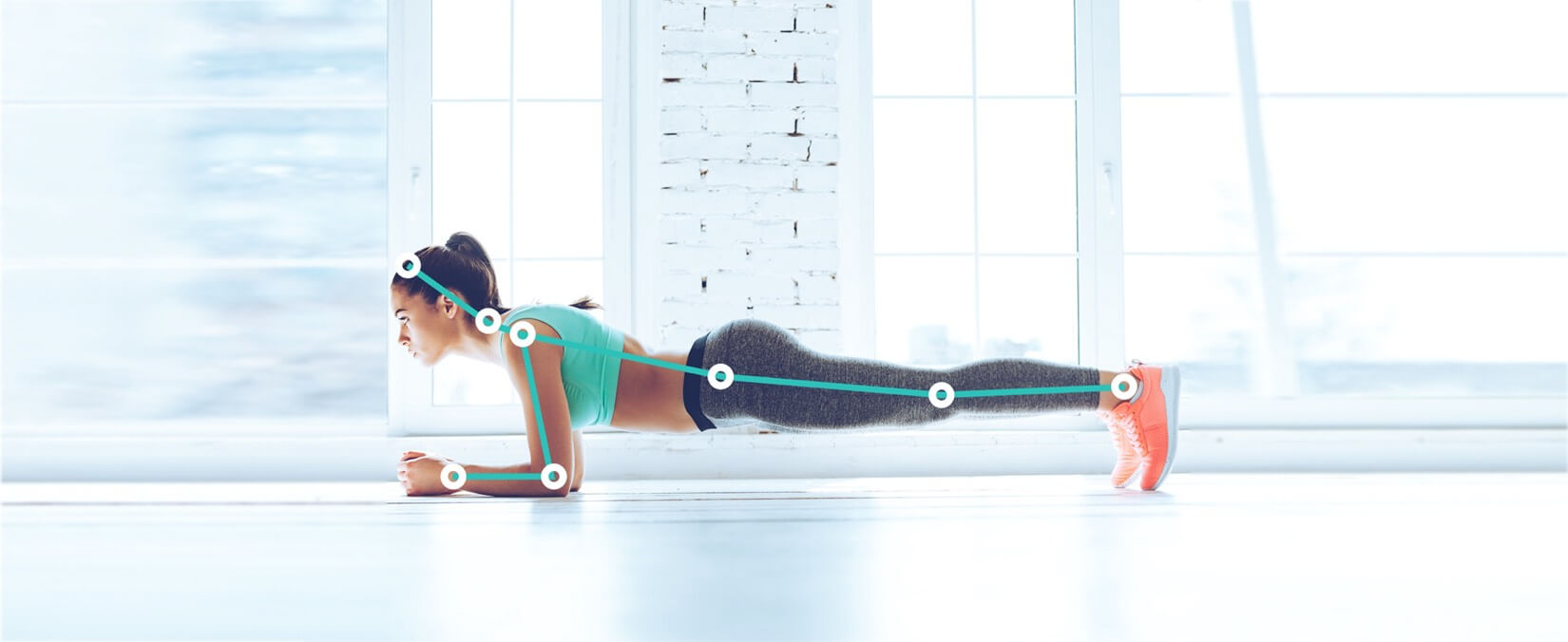

Інший приклад — розробка стартапу Exer. Навесні 2020 року він представив онлайн-тренера, який стежить за заняттям у режимі реального часу. Перед запуском застосунок обробив десятки тисяч фото, на яких тренувалися люди. За допомогою камери та машинного навчання застосунок стежить за рухами користувача і коригує їх. У компанії зазначили, що під час запуску застосунку люди не могли відвідувати спортзали через самоізоляцію.

Приклад роботи Exer

Розробник Ітан Розенталь, теж сидячи вдома під час карантину, створив рецепт ідеального сендвіча з бананом і арахісовою пастою. Система за фото визначає, як краще розрізати банан, щоб рівномірно розташувати шматочки. Нейромережа створює криву, яка проходить по осі банана, а потім «нарізає» його на овали. Потім алгоритм обирає оптимальний спосіб розташування банана на хлібі.

Джерело: блог Ітана Розенталя

Ще 2018 року ізраїльські вчені створили нейромережу, яка, навпаки, шукає найкращий спосіб з’єднати фрагменти. Програма допомагає археологам: обробляє знімки та вміє відтворювати початковий вигляд речі за знайденими уламками.

Приклад результатів роботи

Археології потрібні такі алгоритми, тому що артефакти, які знаходять вчені, майже завжди пошкоджені. Людям зазвичай потрібно кілька днів для обробки найпростіших знахідок. Іноді реставрація займає кілька років. Алгоритми можуть відновити початковий вигляд речі набагато швидше.

Комп’ютерний зір може не тільки відновлювати з фрагментів, а й створювати нову реальність. Компанія NVIDIA і MIT представили технологію Video-to-Video. Вона дає змогу створити реалістичне відео на основі шаблону. Завантажуючи вихідні дані, ми отримуємо, наприклад, модель руху машин або промальовування міста.

MIT працював над ще одним проєктом — Temporal Relation Network. Дослідники навчили нейромережу не просто визначати, який вигляд мають предмети, а й розуміти, що з ними роблять. Для цього TRN обирає кілька ключових кадрів із потоку відео. Потім мережа аналізує їх і вчиться порівнювати зміни. У MIT вважають, що технологію можна буде використовувати для selfsupervised-навчання роботів.

Обкладинка: Towards Data Science