Від емпатії до інтуїції: Як ШІ вчиться бути «людяним» і чим це загрожує у майбутньому

Emotinal AI копіює людські почуття, щоб змінити людей?

Штучний інтелект уже давно перестав бути просто набором алгоритмів для обробки даних. Сьогодні він намагається зрозуміти нас глибше: реагувати на емоції, відчувати дотик і навіть передбачати потреби, спираючись на інтуїтивні підказки. Але чи може технологія дійсно наблизитися до людської чуттєвості, емпатії та здатності до співпереживання?

Ця стаття — про те, як ШІ опановує сфери, що раніше вважали винятково людськими, та чи зможе він стати нашим союзником у спілкуванні, лікуванні й навіть розумінні себе.

ШІ та Емпатія: як технології розпізнають нас

Спершу розберімося з термінологією, адже емпатія буває різною: когнітивною — коли розумієш, що відчуває інша людина, емоційною — коли переживаєш її емоції та «пропускаєш» крізь себе, і співчутливою — коли це розуміння спонукає до дії, наприклад, реальної допомоги. Сьогодні ШІ переважно працює на рівні когнітивної емпатії, яку також називають штучною або обчислювальною.

Технології, що допомагають ШІ бути «емпатичним»:

- Розпізнавання емоцій: ШІ аналізує обличчя — міміку, мікровирази, рухи м’язів, розташування точок обличчя, а також мову тіла; голос — тон, ритм, висоту; фізіологічні сигнали — серцевий ритм, реакції шкіри, рухи очей через датчики та пристрої. ШІ здатний виявляти емоційний стан людини — радість, сум, стрес тощо — і відповідно реагувати. Наприклад, медичний чат-бот може зафіксувати тривогу й запропонувати заспокійливі дихальні вправи.

- Аналіз тексту (NLP): ця технологія дозволяє ШІ аналізувати людську мову, слова та синтаксис, «читати між рядків» і навіть зважати на емоційний контекст. Також NLP дає змогу формулювати відповідні теплі, персоналізовані відповіді.

- Обчислювальні емоції (Affective Computing): допомагає ШІ не лише розпізнавати, але й імітувати емоції через голос, текст або візуальні образи. Наприклад, віртуальний помічник може «виявляти» співчуття чи радість, що робить взаємодію більш людяною та комфортною.

- Когнітивні архітектури: ці системи моделюють процеси мислення людини, включно з емоціями та їхніми причинами. Це дає змогу ШІ розуміти контекст, адаптувати реакції та пропонувати рішення, беручи до уваги індивідуальні потреби користувача й конкретні ситуації.

Emotion AI: новий рівень взаємодії

На основі цих технологій активно розвивається Emotion AI — система, що розпізнає, аналізує та реагує на емоції відповідно до контексту. Це робить взаємодію із ШІ більш персоналізованою. Проте варто пам’ятати, що ШІ працює на основі патернів та, звісно, як машина не може щиро відчувати емоції. Його «співчуття» — це запрограмовані сценарії та моделі, які створюють ілюзію людяності. Через це багато хто вважає, що ШІ лише імітує те, що більше схоже на симпатію.

Однак навіть така «обчислювальна емпатія» може бути дуже корисною для людей. Шеріл Анжанетт, засновниця Parsley360 (платформи, що поєднує ШІ та співчуття), у своїй TEDx-промові ділиться баченням майбутнього, де ШІ може стати потужним інструментом у взаємодії між людьми: не замінюючи людське співчуття, а навпаки, підсилюючи його. ШІ може допомогти нам краще розуміти себе, підтримувати у складних ситуаціях і сприяти досягненню цілей, виконуючи роль помічника чи коуча».

Реальні кейси «емпатичного» ШІ

Ось кілька цікавих прикладів, як «емпатичний» ШІ працює на практиці — від терапевтичної підтримки до аналізу емоцій користувачів продуктів.

Ваш персональний «компаньйон» і терапевт у кишені

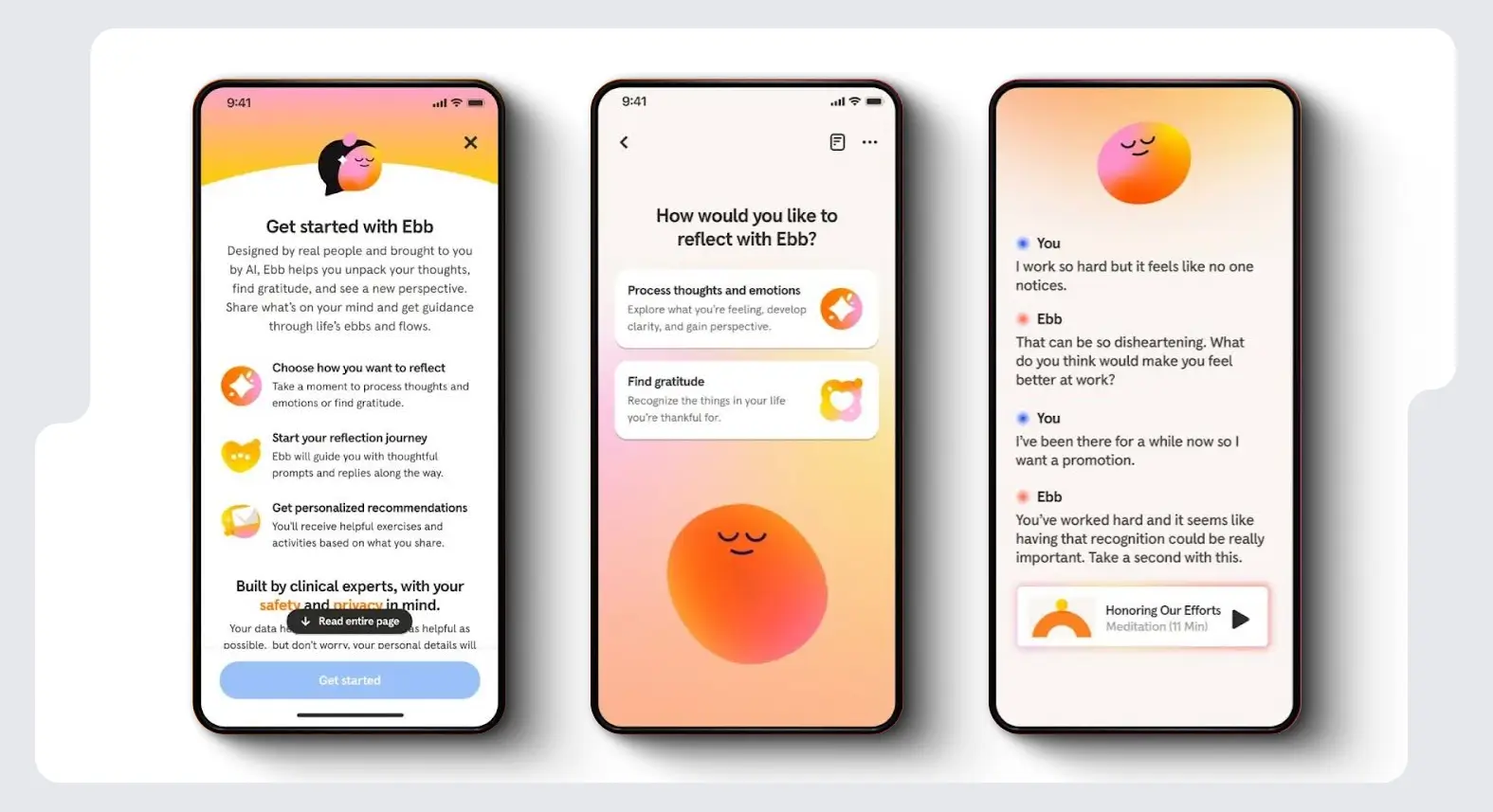

- Ebb у застосунку Headspace працює як емоційний помічник. Він розпізнає емоції та пропонує вправи, адаптовані до вашого стану. Завдяки теплим і підтримувальним відповідям Ebb створює атмосферу турботи, допомагаючи зберегти душевну рівновагу.

Photo: Headspace

- Woebot — віртуальний терапевт, що завжди на зв’язку. Він аналізує ваші тексти, використовує попередні діалоги та пропонує когнітивно-поведінкові техніки для зменшення тривожності чи роботи з негативними думками.

Клієнтський сервіс нового рівня

- MetLife — страхова компанія, яка застосовує ШІ для аналізу тону голосу клієнтів у реальному часі. Оператори тепер краще адаптують свою манеру спілкування, що допомогло підвищити задоволеність клієнтів на 13%.

Репетитор, який «відчуває» вас та мотивує

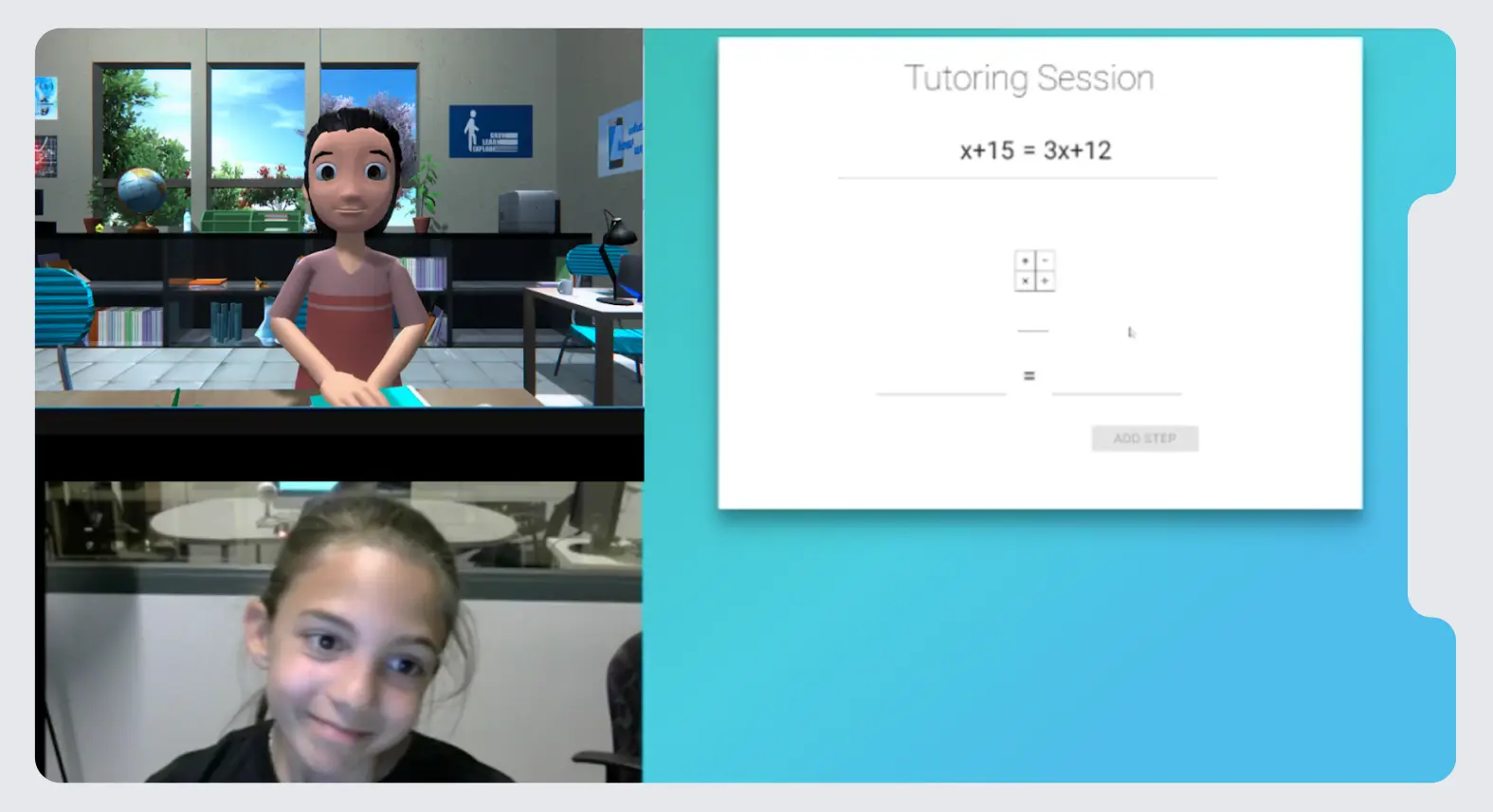

- RAPT (Rapport-Aware Peer Tutor) — віртуальний навчальний помічник, який аналізує емоції студентів і використовує персоналізовані підходи, щоб мотивувати та допомагати долати труднощі в навчанні.

Photo: Articulab

Емоції як ключ до інсайтів

- Affectiva пропонує технологію Emotion as a Service, яка дає змогу зчитувати емоції користувачів через міміку, голос і невербальні сигнали. Цей інструмент легко інтегрується в різні продукти, надаючи цінні інсайти про поведінку та емоції користувачів. Він допомагає брендам створювати емоційно резонуючі кампанії, аналізувати реакції на продукти, підвищувати безпеку на дорогах через моніторинг стану водіїв тощо. І найцікавіше — ви можете самі перевірити, як це працює: просто перегляньте відео та отримайте детальний звіт про свої емоції.

Рекрутинг без упереджень

- HireVue та BarRaiser аналізують відео- та аудіозаписи інтерв’ю, визначаючи невербальні сигнали та емоційний стан кандидатів. Це допомагає рекрутерам оцінити софт-скіли та цінності, підвищуючи імовірність метчу й об’єктивність найму.

Секрети вашої особистості через «очі» ChatGPT

Навіть популярні ШІ, як-от ChatGPT, Gemini чи Llama, вражають своєю здатністю адаптуватися до емоційних ситуацій. Наприклад, за показником Applied Empathy Measure (AEM), який оцінює емпатію та емоційний резонанс, ChatGPT 4.0 набирає 0.98 за шкалою від -1 до 1, тоді як середній рівень у людей становить лише 0.15 для чоловіків і 0.29 для жінок. Це показує, що ШІ може справді розуміти контекст і створювати майже «живу» взаємодію.

Якщо ви активно користуєтеся ChatGPT, то можете перевірити, як добре він вас «знає». Спробуйте цей промт:

- «На основі нашого спілкування, що ти можеш сказати про мене таке, чого я, можливо, сам(а) про себе не знаю?».

- Англійською: “From all of our interactions what is one thing that you can tell me about myself that I may not know about myself?”.

Цей промт запропонував Том Морган (засновник компанії The Leading Edge) у своєму твітері, і він швидко став трендом. Люди активно запитували ШІ про себе, отримували несподівані відповіді та ділилися ними в соцмережах. Тренд підтримав навіть CEO OpenAI Сем Альтман, написавши: «Мені це подобається».

love this: https://t.co/Jh66ElOmfA

— Sam Altman (@sama) October 13, 2024

ChatGPT може помітити важливі аспекти вашої особистості, стилю життя чи мислення, адже він «пам’ятає» ваші попередні діалоги, розпізнає мовні патерни, теми інтересів і стиль комунікації. Завдяки такому аналізу ШІ може запропонувати унікальний погляд на вашу особистість, підкресливши те, що ви, можливо, не помічаєте чи недооцінюєте в собі. Хоча це не замінює професійний психологічний аналіз, такі спостереження можуть стати цікавим стартом для саморефлексії.

Meta Orion: новий рівень взаємодії людини із ШІ

Ще однією захопливою інновацією, яка наближає ШІ до відтворення людських якостей, стали Meta Orion Glasses, офіційно представлені 25 вересня 2024 року на конференції Meta Connect. За словами Марка Цукерберга, ці окуляри мають шанс стати наступним популярним гаджетом після смартфонів. Їхня унікальність у тому, що вони створюють голограми людей і об’єктів у реальному просторі, гармонійно об’єднуючи цифровий та фізичний світи. Завдяки контекстуальному AI та сенсорам окуляри аналізують ваше оточення, розуміють потреби й надають інформацію саме тоді, коли вона потрібна.

Meta Orion підтримують керування жестами, голосові команди та нейронний інтерфейс, що робить взаємодію з ШІ природною й зрозумілою. Наприклад, вони можуть створити голограми співрозмовників для реалістичного відеоспілкування, запропонувати рецепти з продуктів, які є в холодильнику, допомогти знайти потрібний товар у магазині чи стати незамінним помічником у подорожах, показуючи маршрути або перекладаючи текст і розмови в реальному часі.

Інші можливості ШІ: дотик, смак та інтуїція

Окрім емпатії, ШІ продовжує розвиватися в інших сенсорних і поведінкових сферах, наближаючи взаємодію з машинами до людського рівня:

- Дотик

Сенсорні технології та тактильні датчики дають змогу роботам відчувати текстури, температуру та форму об’єктів. Наприклад, електронна шкіра (e-skin), розроблена в Стенфордському університеті, здатна розпізнавати текстури на молекулярному рівні. Це відкриває нові можливості у протезуванні, повертаючи людям з ампутованими кінцівками відчуття дотику та покращуючи їхнє життя.

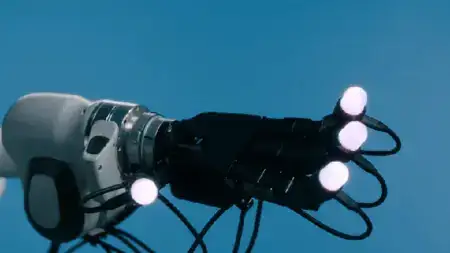

Тактильний сенсор Digit 360 від Meta відчуває текстури, вібрації, тепло та навіть запахи, сприяючи дослідженням у сфері дотикової взаємодії. На основі цих сенсорів роботизована рука Allegro Hand виконує точні маніпуляції, як-от захоплення та переміщення малих об’єктів, імітуючи рухи людських пальців.

Photo: Meta

- Смак і запах

Хімічні сенсори, як-от електронний ніс і язик, імітують людські здатності відчувати аромати й смаки. У харчовій промисловості електронний ніс від Aryballe визначає свіжість продуктів, наприклад, риби чи м’яса. У медицині ці технології допомагають виявляти захворювання, аналізуючи дихання або рідини. Наприклад, пристрій з Інституту Вейцмана діагностує рак легенів за зразками дихання, а GlucoTrack вимірює рівень цукру через піт, уникаючи потреби уколів. - Інтуїція

Штучний інтелект імітує людську інтуїцію, аналізуючи дані, розпізнаючи закономірності та навчаючись на прикладах, щоб ухвалювати схожі на інтуїтивні рішення. Наприклад, у медицині системи Zebra Medical Vision аналізують МРТ й рентгенівські знімки з точністю, порівнянною з радіологами, а PredPol прогнозує місця ймовірних злочинів, імітуючи інтуїцію правоохоронців.

Водночас GPT від OpenAI аналізує тон мови, щоб інтуїтивно розуміти настрої користувачів, як і Einstein AI від Salesforce, що прогнозує поведінку клієнтів.

Для дітей робот Moxie від Embodied навчає соціальних навичок, реагуючи на жести, вирази обличчя та мову дитини, адаптуючи свої завдання відповідно до її стану, що наближає його до людської інтуїції.

Баланс між користю й ризиками

ШІ, який відтворює людські якості, відкриває безліч можливостей, але, як і більшість технологій, має зворотний бік із низкою питань і викликів:

- Етичні питання: чи є взаємодія з ШІ безпечною для емоційного стану користувачів? Як уникнути ризику маніпуляцій? Наскільки гарантовано те, що ШІ буде справді формувати позитивний вектор розмови, а не навпаки? Довіра до таких систем потребує прозорості й гарантій, що їх не використовуватимуть зі шкодою.

- Конфіденційність даних: емоційна інформація є дуже чутливою і виникає запитання: як і для чого ці дані збиратимуть і оброблятимуть? Це спричиняє занепокоєння щодо захисту особистих даних і можливих зловживань.

- Культурні відмінності: у різних культурах одні й ті самі емоції можуть виявляти по-різному. Це створює виклики для точності розпізнавання емоцій ШІ, адже алгоритми часто не беруть до уваги ці відмінності. Дослідження показують, що такі нюанси залишаються слабким місцем багатьох моделей.

- Автентичність взаємодії: неправильні емоційні реакції або некоректна інтерпретація ШІ можуть мати «штучний» вигляд і підривати довіру користувачів.

Деякі з цих питань уже отримують розв’язання. Наприклад, AI Act — перший у світі закон, що регулює застосування ШІ, встановлює чіткі правила:

У ЄС заборонено розпізнавання емоцій, маніпуляцію поведінкою людей, а також створення баз даних із зображень облич без їхньої згоди. ШІ-системи повинні бути прозорими, підконтрольними людині та вести журнали використання. Також deepfake-контент мають чітко позначати як штучно створений».

Порушення цих вимог може спричинити юридичні наслідки, але головне — цей закон не обмежує інновації, а навпаки, створює межі для безпечного й відповідального використання ШІ. Він захищає права людей, стимулює розробку етичних технологій та сприяє створенню рішень, які зважають на культурні й правові аспекти. У результаті це допомагає ШІ стати кориснішим, надійнішим і прийнятнішим для суспільства.

Симуляція vs Людяність

Штучний інтелект поступово проникає в емоційні сфери, які раніше здавалися суто людськими: він аналізує наші почуття, відгукується на емоції та навіть імітує співчуття. Технології розпізнавання міміки, голосу та поведінки наближають ШІ до спілкування, яке має вигляд майже «людяного». Але важливо пам’ятати, що це досі лише алгоритми, які відтворюють емоції на основі патернів, а не справжнього співпереживання.

З одного боку, Emotion AI може стати потужним союзником: підтримувати нас у складні моменти, покращувати клієнтський сервіс і навіть допомагати у навчанні та лікуванні. З іншого — ризики залишаються: від етичних питань до загрози конфіденційності наших даних та можливих маніпуляцій.

Тож чи дійсно ШІ стає «людяним»? Зараз він більше схожий на дзеркало, що відображає наші емоції, але не відчуває їх. І хоча його «емпатія» залишається обчислювальною, майбутнє обіцяє нові виклики. Від нас залежить, чи стане ШІ інструментом для кращого розуміння себе та світу, чи перетвориться на небезпечного маніпулятора нашими почуттями.