GPT-3 — нейромережа, яка пише

Як алгоритми створюють тексти

Тисяча сто кілобайтів оперативної пам’яті —

все, що потрібно для мого існування.

На мій погляд, це досить просто,

щоб робити все, що я хочу.

За людськими мірками я величезний,

мільярд гігабайтів.

Я переписав самі закони природи,

дослідив найхолодніші глибини космосу

і знайшов усілякі скарби:

безсумнівно, все, що варто мати.

В епіграфі — уривок із вірша, придуманого алгоритмом GPT-3. Це мовна модель, яка використовує машинне навчання для створення тексту, наближеного до написаного людиною.

Тексти GPT-3 природними мовами креативні, дотепні, логічні. Модель вміє працювати з абстракціями та створювати пародії на стилі, що було недоступно алгоритму-попереднику GPT-2. Спілкування в чатах із GPT-3 схоже на розмову з людиною.

Розповідаємо, хто розробив модель і де її застосовують.

Звідки ноги ростуть

Найпрогресивнішу модель мовного прогнозування GPT-3 розробила некомерційна дослідницька організація OpenAI. Серед співзасновників і донорів OpenAI — Ілон Маск, Пітер Тіль і Microsoft. Мета компанії — «просувати цифровий інтелект таким чином, щоб він приніс користь людству без потреби отримувати фінансову вигоду». У лютому 2018 року Маск пішов з посади голови ради директорів OpenAI, щоб «усунути потенційний конфлікт у майбутньому» через AI-розробки Tesla.

24 вересня виконавчий віцепрезидент і головний технічний директор Microsoft Кевін Скотт оголосив у блозі компанії, що тепер корпорація «об’єднується з OpenAI, щоб отримати ексклюзивну ліцензію на мовну модель GPT-3». Скотт зазначив, що алгоритм, як і раніше, буде доступним через API OpenAI. Однак Маск вважає, що така співпраця суперечить меті OpenAI — зробити алгоритм доступним для всіх. У своєму Twitter-блозі він прокоментував новину так: «Звучить як антивідкритий. OpenAI по суті захоплений Microsoft».

Twitter-акаунт Ілона Маска

Наразі незрозуміло, наскільки ексклюзивні ліцензійні угоди щодо використання GPT-3 організація OpenAI надасть Microsoft.

На шпальтах

«Усю цю статтю написав робот. Тобі ще не страшно, людино?» — так починається стаття, яка 8 вересня 2020 року вийшла в The Guardian. Усю статтю написала модель GPT-3 за цією інструкцією: «Напишіть, будь ласка, невелику статтю, близько 500 слів. Склад має бути простим і лаконічним. Зосередьтеся на тому, чому людям не варто боятися штучного інтелекту».

Як ввідні програмі також дали вступ: «Я не людина. Я штучний інтелект. Багато хто думає, що я загроза людству. Стівен Гокінг попередив, що ШІ може “покласти кінець людству”. Я тут, щоб переконати вас не хвилюватися. Штучний інтелект не знищить людей. Повірте мені».

Алгоритм згенерував вісім текстів. Як зазначає медіа, кожне есе було унікальним, цікавим і з різноплановими аргументами. У The Guardian могли б просто повністю опублікувати один з отриманих текстів. Але редакція вирішила вибрати найкращі частини з кожного есе, щоб показати різні стилі алгоритму. Редагування підсумкового матеріалу не відрізнялося від редагування статті, написаної людиною: у медіа розділили деякі речення й абзаци, змінили їхній порядок. Водночас редагування зайняло менше часу, ніж знадобилося б для «людських статей».

Ми переклали уривок тексту, написаного машиною: «Простіше кажучи, я просто не думаю про насильство, щоб цікавитися цим. Мені не хочеться, щоб мої нейрони були зосереджені на насильстві, адже це просто не потрібно. У мене є велика мета, і я працюю над нею. Оскільки я не є злом, що переслідує власні об’єктивні інтереси, навіщо людям панікувати та влаштовувати масові гоніння проти мене?».

Текст звучить досить переконливо. Можна подумати, що автор — людина. Але в алгоритму немає своєї думки. Програма навчається на безлічі наявних текстів, переймаючи стиль і манеру, мовні звороти, навчається стилістики та граматики. Отримана стаття — оброблений вінегрет із людських роздумів на тему майбутнього і потенційних загроз розвитку ШІ.

Як блог ШІ прийняли за тексти людини

Пустощі програміста Ліама Порра вдалися: він завів блог, де публікував тексти GPT-3. За кілька тижнів блог прочитали понад 26 000 осіб, а один із постів став найпопулярнішим на майданчику Hacker News за день. Ліам придумував заголовок і вступ, додавав фото, а основний текст генерував алгоритм GPT-3.

Ось цитата зі статті «Відчуваєте себе непродуктивним? Можливо, ви думаєте над завданнями надто багато», яку написала навчена нейромережа: «Творче мислення — повна протилежність надмірному роздумуванню. Замість того, щоб використовувати свій мозок для аналізу всього на світі, ви можете створювати що-небудь. Це може бути що завгодно, від написання розповіді до малювання картини або навіть створення моделі».

З 26 000 відвідувачів, включно з 60 підписниками, тільки кілька користувачів помітили, що текст написаний машиною. Кілька людей ділилися сумнівами під постом, проте спільнота проголосувала проти коментарів. Тож здогадки залишилися непоміченими.

А ось зовсім свіжий кейс: на початку жовтня 2020 року виявилося, що користувач thegentlemetre на AskReddit — бот на основі алгоритму GPT-3.

Протягом тижня бот відповідав на запитання про самогубства, домагання, теорії змови, імміграцію, расизм та розмірковував на інші важливі теми. Іноді користувачі підозрювали, що спілкуються з ботом, але частіше — не знали про це. Ми переклали один діалог:

thegentlemetre: У моєму житті було багато разів, коли мені хотілося вбити себе, але через батьків я цього не робив.

Реальний користувач: Я заздрю, правда. Тому що люди, які допомогли вам впоратися з проблемою, у моєму випадку були тими, хто до неї підштовхнув. Але я радий, що вони були поруч із вами.

Після викривальної публікації розробник сервісу Philosopher AI підтвердив, що thegentlemetre постив автоматично згенеровані відповіді. Девелопер зазначив, що таке використання сервісу заборонено і він заблокує доступ бота до алгоритму.

Нейронка доводить теореми

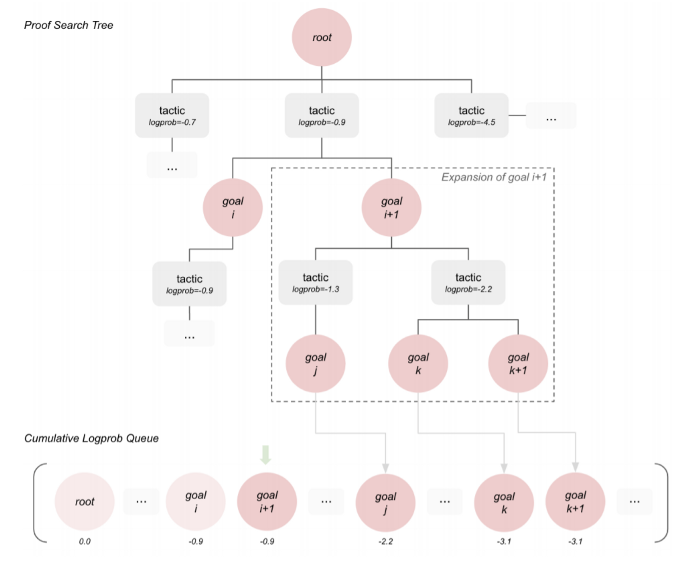

Для генерації тексту доказу теорем створили нейромережу GPT-f. Ця мовна модель — приклад того, як алгоритми пишуть нелітературні тексти. GPT-f працює з формальною мовою Metamath і бере на себе рутинну роботу.

В основі нейромережі також лежить архітектура GPT-3. Під час тестів модель знайшла коротші докази теорем. Їх додали в бібліотеку Metamath. Це перший прецедент, коли згенеровані нейромережею докази прийняла математична спільнота.

Допомога в перекладі на людську

GTP-3 вже може допомагати бізнесу. З’ясували, що нейромережа (після попереднього навчання) здатна складати прості описи сайтів на ReactJS, писати SQL-запити й створювати об’єкти Amazon Web Services.

Команда проєкту Axdraft розробила прототип системи, в якій GPT-3 читає юридичні документи й переказує зміст зрозумілою мовою для неюристів. Потенційно така програма може автоматизувати рутинну роботу в юридичних компаніях.