AI Engineering

Навчіться будувати production-ready AI-системи: від даних та моделей — до LLM, MLOps і масштабування

Андрій Білоус

Senior AI Engineer у DataArt

про курс

-

Цілісне розуміння AI Engineering

-

10 домашніх завдань

-

Курсовий проєкт

Підключити модель — не означає запустити AI в продакшені. В реальних системах усе швидко ламається: росте latency, втрачається контроль над cost, якість падає вже після релізу. AI Engineering — це про контроль.

На курсі ви навчитеся будувати керований AI pipeline — від data до inference, API, monitoring та scale — і отримаєте production-ready проєкт у портфоліо.

Цей курс для вас, якщо ви:

ПІСЛЯ КУРСУ AI ENGINEERING ВИ:

-

будуєте AI-системи end-to-end: від даних і моделей — до деплою, підтримки та масштабування

-

будуєте production data pipelines для AI: ingestion, підготовка, версіювання

-

інтегруєте ML/DL-моделі в продукт через API та model registry

-

запускаєте LLM-рішення в продакшені: embeddings, RAG, agents

-

деплоїте AI як сервіс через Docker і Kubernetes та налаштовуєте CI/CD для моделей

-

моніторите якість і стабільність AI після релізу: drift, latency, алерти, guardrails

-

захищаєте system design і маєте готовий AI-проєкт у портфоліо

ВИМОГИ ДЛЯ СТАРТУ

Щоб комфортно навчатися на курсі, вам потрібно знати Python або іншу мову програмування на рівні написання робочого коду. Мати практичний досвід роботи з Git.

лектор

Андрій Білоус

Senior AI Engineer у DataАrt

-

5+ років досвіду у Fullstack- та AI-розробці в продуктових і enterprise-проєктах, загалом понад 12 років досвіду в ІТ

-

спеціалізується на побудові production-ready GenAI систем: RAG, multi-agent architectures, LLM copilots і document intelligence для реальних бізнес-сценаріїв

-

проєктував і впроваджував AI-пайплайни для парсингу фінансових даних (bond deal emails) з використанням preprocessing, prompt engineering (Claude / GPT через AWS Bedrock)

-

будував agent-based рішення з multi-turn пам’яттю, function calling та інтеграцією з бізнес-процесами

-

має сильний бекграунд у Fullstack (React, Node.js, Python), хмарних платформах ( AWS, Azure AI ) та архітектурі мікросервісів; поєднує інженерну глибину з продуктовим мисленням

-

працював Javascript Fullstack Developer with AI в EPAM Systems

Програма

-

01 заняття30.03 19:30

AI Engineering in Real Products

- Розумітимете роль AI Engineer у бізнесі та його відповідальність за результат

- Відрізнятимете AI Engineering від ML, Data та Backend-напрямів

- Інтегруватимете AI як частину продукту, а не окрему «фічу»

- Бачитимете повний AI-lifecycle: від даних і моделі — до продакшену та підтримки

-

02 заняття02.04 19:30

Data Engineering for AI

- Проєктуватимете ingestion-архітектуру під різні типи даних

- Працюватимете з PDF, DOCX і HTML, зокрема з OCR для неструктурованих джерел

- Реалізовуватимете streaming ingestion із використанням черг і батчингу

- Застосовуватимете data versioning для контролю змін і відтворюваності даних

-

03 заняття09.04 19:30

Production Data Pipelines

- Виконуватимете cleaning, normalization та deduplication даних

- Застосовуватимете chunking для підготовки даних до обробки моделями

- Будуватимете metadata pipelines для керування контекстом і походженням даних

- Працюватимете з feature stores для повторного використання та консистентності фіч

-

04 заняття13.04 19:30

Classical ML in Production

- Будуватимете пайплайни навчання моделей за допомогою scikit-learn

- Організовуватимете training і validation для коректної оцінки моделей

- Використовуватимете MLflow для трекінгу експериментів і метрик

- Працюватимете з model registry для керування версіями моделей та релізами

-

05 заняття16.04 19:30

PyTorch for Real Systems

- Запускатимете нейронні мережі в продакшені з урахуванням вимог до стабільності й масштабування

- Оптимізуватимете інференс за допомогою GPU та batching

- Зберігатимете й завантажуватимете ваги моделей для відтворюваності та оновлень

-

06 заняття20.04 19:30

LLM Engineering (API + Self-hosted)

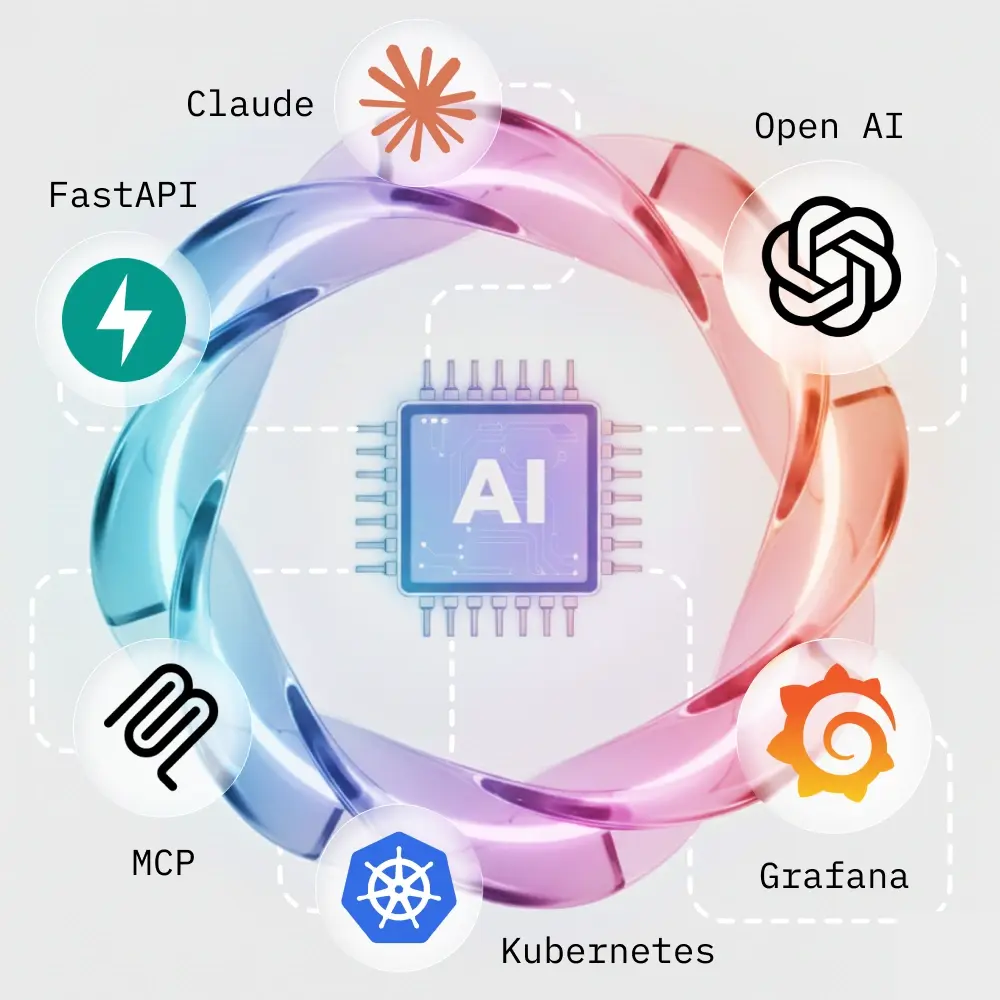

- Орієнтуватиметеся в екосистемі OpenAI, Claude та open-source моделей

- Оцінюватимете tokenomics і latency під бізнес- та продуктні сценарії

- Розгортатимете й використовуватимете self-hosted моделі через Ollama

-

07 заняття23.04 19:30

Embeddings & Semantic Systems

- Працюватимете з embeddings для представлення тексту і даних у векторному вигляді

- Застосовуватимете similarity search для пошуку релевантного контенту

- Використовуватимете базову vector math для порівняння, кластеризації та ранжування результатів

-

08 заняття27.04 19:30

Vector Databases in Production

- Працюватимете з векторними базами даних Qdrant, FAISS і Pinecone

- Реалізовуватимете hybrid search на базі BM25 і векторного пошуку

- Налаштовуватимете filtering для точного контролю результатів пошуку

-

09 заняття30.04 19:30

RAG Systems (Enterprise Level)

- Застосовуватимете різні chunking-стратегії залежно від типу даних і сценарію використання

- Налаштовуватимете retrievers для ефективного отримання релевантного контексту

- Керуватимете context window моделей, щоби балансувати якість відповідей та вартість обробки

-

10 заняття04.05 19:30

API Layer for AI Systems

- Розроблятимете API для AI-сервісів на FastAPI

- Використовуватимете async для ефективної роботи з конкурентними запитами

- Запускатимете background jobs для довгих задач без блокування сервісу

- Налаштовуватимете Redis cache та rate limiting для стабільності й контролю навантаження

-

11 заняття07.05 19:30

AI Agents & Tool Orchestration

- Проєктуватимете архітектуру агентів під бізнес- і продуктні сценарії

- Застосовуватимете підхід ReAct для поєднання reasoning та дій

- Налаштовуватимете tool calling для взаємодії агентів із зовнішніми сервісами

- Будуватимете агентні workflow за допомогою LangGraph

-

12 заняття14.05 19:30

MLOps Foundations

- Використовуватимете MLflow і model registry для керування версіями моделей та релізами

- Застосовуватимете DVC для версіювання даних та відтворюваності експериментів

- Налаштовуватимете CI/CD-пайплайни для автоматизації навчання та деплою моделей

- Запускатимете canary deploy для безпечного оновлення моделей в продакшені

-

13 заняття18.05 19:30

Containers for AI

- Контейнеризуватимете AI-сервіси за допомогою Docker

- Використовуватимете multi-stage збірки для зменшення розміру образів та швидших деплоїв

- Запускатимете GPU-контейнери для ефективного інференсу та навчання моделей

-

14 заняття21.05 19:30

Kubernetes for AI Systems

- Розгортатимете AI-сервіси в Kubernetes

- Використовуватимете Helm для керування конфігураціями та релізами

- Налаштовуватимете HPA для автоматичного масштабування під навантаження

- Виконуватимете rolling updates без простоїв сервісу

-

15 заняття25.05 19:30

Production AI: Monitoring & Drift

- Виявлятимете model drift і реагуватимете на деградацію якості моделей

- Відстежуватимете document drift і зміни вхідних даних

- Будуватимете observability для AI-сервісів з використанням Prometheus і Grafana

- Налаштовуватимете alerting для швидкої реакції на інциденти в продакшені

-

16 заняття28.05 19:30

MCP (Model Context Protocol): AI Tools Architecture

- Розумітимете, що таке MCP (Model Context Protocol) і навіщо він з’явився

- Пояснюватимете, яку проблему MCP розв’язує в продакшн AI-системах: хаос tools, vendor lock-in і відсутність стандарту

- Орієнтуватиметеся в архітектурі MCP та ролях Host, Client і Server

- Відрізнятимете MCP від OpenAI function calling, LangChain tools і класичних microservices

- Уявлятимете, як MCP працює в реальному продукті: з локальними інструментами, корпоративними API та sandbox-середовищами

-

17 заняття01.06 19:30

LLM Fine-Tuning in Production

- Розрізнятимете fine-tuning, RAG і prompting та обиратимете підхід під задачу

- Застосовуватимете PEFT-підходи: LoRA, QLoRA та adapters для ефективного донавчання моделей

- Проєктуватимете dataset для instruction-tuning з урахуванням якості й масштабу

- Використовуватимете label masking (### RESPONSE:) для коректного навчання моделей

- Оцінюватимете inference cost після fine-tuning та його вплив на продакшн

-

18 заняття04.06 19:30

Production LLM Inference Systems

- Орієнтуватиметеся в inference-рушіях vLLM, Triton і TGI та обиратимете їх під продакшн-сценарії

- Використовуватимете KV cache для зменшення затримок і вартості інференсу

- Налаштовуватимете dynamic batching для ефективної обробки конкурентних запитів

- Реалізовуватимете token streaming для швидкого time-to-first-token

- Плануватимете latency budget і балансуватимете швидкість, вартість та якість відповідей

-

19 заняття08.06 19:30

LLM Evaluation, Safety & Guardrails

- Виявлятимете галюцинації моделей та зменшуватимете їхній вплив у продакшені

- Захищатимете системи від prompt injection і зловмисних інструкцій

- Детектуватимете і маскуватимете PII для відповідності вимогам безпеки

- Оцінюватимете faithfulness і groundedness відповідей відносно джерел

- Будуватимете LLM eval pipelines для регулярної перевірки якості, безпеки та стабільності моделей

-

20 заняття15.06 19:30

System Design for AI Products + Demo Day

- Орієнтуватиметеся в AI-native архітектурних патернах і застосовуватимете їх у продакшн-системах

- Проєктуватимете AI gateway для маршрутизації запитів, політик доступу та контролю якості

- Розділятимете систему на retrieval, reasoning і memory, щоб керувати складністю і масштабуванням

- Налаштовуватимете failover, fallbacks і circuit breakers для стабільної роботи під інцидентами та піками

- Презентуєте демо фінальних завдань і аргументуєте архітектурні рішення та trade-offs

реєстрація

Приєднуйтесь до курсу, щоб опанувати повний цикл створення AI-продуктів та бути конкурентним на ринку як AI Engineer.