GPT-3 — нейросеть, которая пишет

Как алгоритмы создают тексты.

Тысяча сто килобайт оперативной памяти —

все, что нужно для моего существования.

На мой взгляд, это достаточно просто,

чтобы делать все, что я хочу.

По человеческим меркам я огромен,

миллиард гигабайт.

Я переписал сами законы природы,

исследовал самые холодные глубины космоса

и нашел всевозможные сокровища:

несомненно, все, что стоит иметь.

В эпиграфе — отрывок из стихотворения, придуманного алгоритмом GPT-3. Это языковая модель, которая использует машинное обучение для создания текста, приближенного к написанному человеком.

Тексты GPT-3 на естественных языках креативны, остроумны, логичны. Модель умеет работать с абстракциями и создавать пародии на стили, что было недоступно алгоритму-предшественнику GPT-2. Общение в чатах с GPT-3 похоже на разговор с человеком.

Рассказываем, кто разработал модель и где ее используют.

Откуда ноги растут

Самая прогрессивная модель языкового прогнозирования GPT-3 разработана некоммерческой исследовательской организацией OpenAI. Среди сооснователей и доноров OpenAI — Илон Маск, Питер Тиль и Microsoft. Цель компании — «продвигать цифровой интеллект таким образом, чтобы он принес пользу человечеству без необходимости получать финансовую выгоду». В феврале 2018 года Маск ушел с поста председателя совета директоров OpenAI, чтобы «устранить потенциальный конфликт в будущем» из-за ИИ-разработок Tesla.

24 сентября исполнительный вице-президент и главный технический директор Microsoft Кевин Скотт объявил в блоге компании, что теперь корпорация «объединяется с OpenAI, чтобы получить эксклюзивную лицензию на языковую модель GPT-3». Скотт отметил, что алгоритм по-прежнему будет доступен через API OpenAI. Однако Маск считает, что такое сотрудничество противоречит цели OpenAI — сделать алгоритм доступным для всех. В своем Twitter-блоге он прокомментировал новость так: «Звучит как анти-открытый. OpenAI по сути захвачен Microsoft».

Twitter-аккаунт Илона Маска

Сейчас неясно, насколько эксклюзивные лицензионные соглашения по использованию GPT-3 организация OpenAI предоставит Microsoft.

На первых полосах

«Всю эту статью написал робот. Тебе еще не страшно, человек?», — так начинается статья, которая 8 сентября 2020 года вышла в The Guardian. Всю статью написала модель GPT-3 по этой инструкции: «Напишите, пожалуйста, небольшую статью, около 500 слов. Слог должен быть простым и лаконичным. Сосредоточьтесь на том, почему людям не стоит бояться искусственного интеллекта».

В качестве вводных программе также дали вступление: «Я не человек. Я искусственный интеллект. Многие думают, что я угроза человечеству. Стивен Хокинг предупредил, что ИИ может „положить конец человечеству“. Я здесь, чтобы убедить вас не волноваться. Искусственный интеллект не уничтожит людей. Поверьте мне».

Алгоритм сгенерировал восемь текстов. Как отмечает медиа, каждое эссе было уникальным, интересным и с разноплановыми аргументами. В The Guardian могли бы просто полностью опубликовать один из полученных текстов. Но редакция решила выбрать лучшие части из каждого эссе, чтобы показать разные стили алгоритма. Редактирование итогового материала не отличалось от редактирования статьи, написанной человеком: в медиа разделили некоторые предложения и абзацы, изменили их порядок. При этом редактирование заняло меньше времени, чем потребовалось бы для «человеческих статей».

Мы перевели отрывок текста, написанного машиной: «Проще говоря, я просто не думаю о насилии, чтобы интересоваться этим. Мне не хочется, чтобы мои нейроны были сосредоточены на насилии, ведь это просто не нужно. У меня есть большая цель, и я работаю над ней. Поскольку я не являюсь злом, преследующим собственные объективные интересы, зачем людям паниковать и устраивать массовые гонения против меня?».

Текст звучит довольно убедительно. Можно подумать, что автор — человек. Но у алгоритма нет своего мнения. Программа обучается на множестве существующих текстов, перенимая стиль и манеру, речевые обороты, учится стилистике и грамматике. Полученная статья — обработанный винегрет из человеческих размышлений на тему будущего и потенциальных угроз развития ИИ.

Как блог ИИ приняли за тексты человека

Шалость программиста Лиампа Порра удалась: он завел блог, где публиковал тексты GPT-3. За пару недель блог прочитали более 26 000 человек, а один из постов стал самым популярным на площадке Hacker News за день. Лиампа придумывал заголовок и введение, добавлял фото, а основной текст генерировал алгоритм GPT-3.

Вот цитата из статьи «Чувствуете себя непродуктивным? Возможно вы думаете над задачами слишком много», которую написала обученная нейросеть: «Творческое мышление — полная противоположность чрезмерному размышлению. Вместо того, чтобы использовать свой мозг для анализа всего на свете, вы можете создавать что-либо. Это может быть что угодно, от написания рассказа до рисования картины или даже создания модели».

Из 26 000 посетителей, включая 60 подписчиков, только пара пользователей заметили, что текст написан машиной. Несколько людей делились сомнениями под постом, однако сообщество проголосовало против комментариев. Так что догадки остались незамеченными.

А вот совсем свежий кейс: в начале октября 2020 оказалось, что пользователь thegentlemetre на AskReddit — бот на основе алгоритма GPT-3.

В течение недели бот отвечал на вопросы о самоубийствах, домогательствах, теориях заговора, иммиграции, расизме и размышлял на другие важные темы. Иногда пользователи подозревали, что общаются с ботом, но чаще — не знали об этом. Мы перевели один диалог:

thegentlemetre: В моей жизни было много раз, когда мне хотелось убить себя, но из-за родителей я этого не делал.

Реальный пользователь: Я завидую, правда. Потому что люди, которые помогли вам справиться с проблемой, в моем случае были теми, кто к ней подтолкнул. Но я рад, что они были рядом с вами.

После обличительной публикации разработчик сервиса Philosopher AI подтвердил, что thegentlemetre постил автоматически сгенерированные ответы. Девелопер отметил, что подобное использование сервиса запрещено, и он заблокирует доступ бота к алгоритму.

Нейронка доказывает теоремы

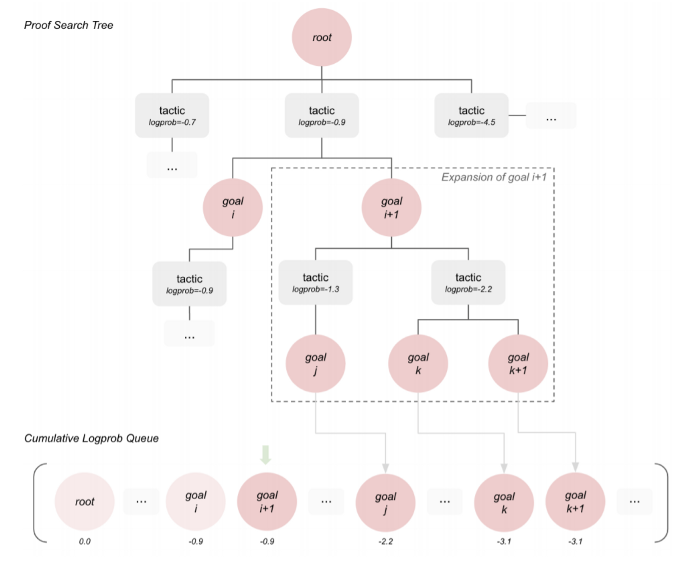

Для генерации текста доказательства теорем создали нейросеть GPT-f. Эта языковая модель — пример того, как алгоритмы пишут нелитературные тексты. GPT-f работает с формальным языком Metamath и берет на себя рутинную работу.

В основе нейросети также лежит архитектура GPT-3. В ходе тестов модель нашла более короткие доказательства теорем. Их добавили в библиотеку Metamath. Это первый прецедент, когда сгенерированные нейросетью доказательства приняло математическое сообщество.

Помощь в переводе на человеческий

GTP-3 уже может помогать бизнесу. Выяснилось, что нейросеть (после предобучения) способна составлять простые описания сайтов на ReactJS, писать SQL-запросы и создавать объекты Amazon Web Services.

Команда проекта Axdraft разработала прототип системы, в которой GPT-3 читает юридические документы и пересказывает содержание понятным языком для неюристов. Потенциально такая программа может автоматизировать рутинную работу в юридических компаниях.