TESTING AI MODELS

Пройдите весь пайплайн системной проверки качества AI-моделей: от классических ML — до LLM и RAG-систем

МАКСИМ КИЗИЦКИЙ

Machine Learning Engineer

КУРС ТЕСТИРОВАНИЯ И ВАЛИДАЦИИ AI-МОДЕЛЕЙ ДЛЯ ВАС, ЕСЛИ ВЫ…

О КУРСЕ

-

Продолжительность: 23 занятия

-

Курсовая работа:

-

СОБСТВЕННЫЙ ПРОЕКТ ПО ТЕСТИРОВАНИЮ AI-СИСТЕМЫ

Модели обновляются — но никто не понимает, стало ли лучше: инженеры смотрят только на accuracy, LLM тестируют «на глаз», а в продакшене все ломается на реальных кейсах.

Превратите AI-проверку в систему: фреймворки, метрики и инструменты, которые позволяют тестировать модели так, чтобы они работали стабильно не в теории, а на практике.

Для выполнения курсового проекта мы предоставляем демо AI-систему, с которой вы будете работать.

ПОСЛЕ КУРСА ВЫ

-

Построите полный процесс тестирования AI-моделей — от pre-release проверок до продакшн-мониторинга

-

Сможете выявлять галлюцинации, нестабильность генерации, bias и edge-cases

-

Будете работать с production-grade стандартами тестирования: Promptfoo, DeepEval, Ragas, Evidently

-

Интегрируете автоматизированное AI-тестирование в CI/CD и MLOps-пайплайны

-

Поймете, как оценивать качество моделей в продакшене и отслеживать деградацию

-

Получите четкую структуру и фреймворк AI-тестирования, который можно сразу применить в команде или продукте

В ПРОГРАММУ КУРСА ВХОДЯТЬ

-

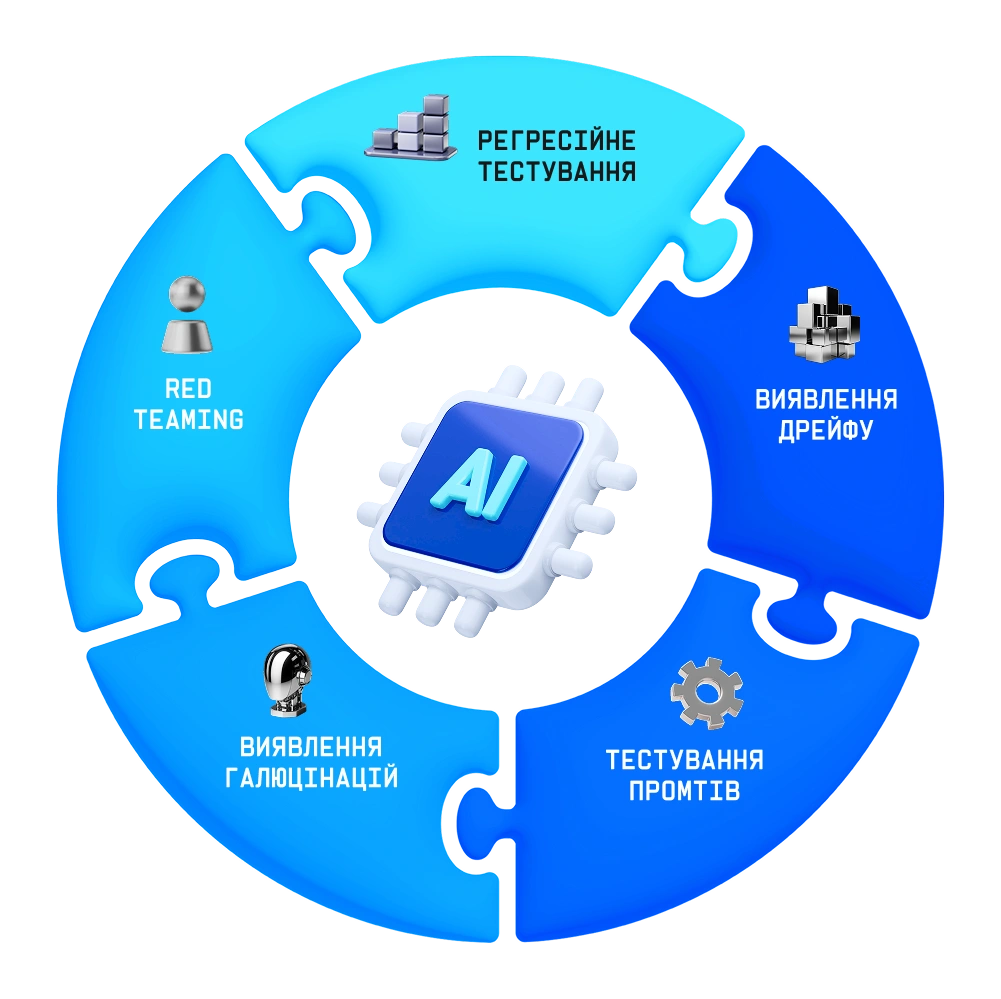

СИСТЕМНОЕ ТЕСТИРОВАНИЕ AI-РЕШЕНИЙ

Освоите подходы к проверке классических ML-моделей, LLM и RAG: научитесь работать с метриками, eval-наборами, регрессиями, галлюцинациями, дрейфом и стабильностью.

-

АВТОМАТИЗАЦИЯ И ПРОДАКШН-ПРАКТИКИ

Интегрируете AI QA в CI/CD, настроите мониторинг качества в продакшене и разберетесь с контролем деградации, производительности и затрат.

-

БЕЗОПАСНОСТЬ И ОТВЕТСТВЕННЫЙ AI

Разберетесь с red-teaming, защитой от prompt-инъекций, тестированием предвзятости, explainability и human evaluation.

-

ФИНАЛЬНЫЙ ПРОЕКТ

В конце курса спроектируете полноценную систему тестирования AI с автоматизированными eval-наборами, метриками и презентацией лектору и коллегам по курсу.

лектор

МАКСИМ КИЗИЦКИЙ

Machine Learning Engineer в TemaBit, Fozzy Group

-

Обладает глубокой экспертизой в Promptfoo, DeepEval, Ragas, LangSmith и Evidently AI.

-

В компании TemaBit отвечает за полный цикл систем — от инференса до мониторинга, внедряет evaluation-фреймворки для RAG и детекцию галлюцинаций.

-

Достиг 5× прироста скорости инференса, внедрил TTFT и P95/P99 latency для контроля производительности.

-

Работает над PhD-исследованием по оценке LLM (украиноязычные, многоязычные, мультимодальные задачи, предотвращение галлюцинаций).

ПРОГРАММА ТЕСТИРОВАНИЯ И ВАЛИДАЦИИ AI-МОДЕЛЕЙ

-

01 заняття04.05.2026 19:00

Введение в тестирование AI-систем

- Поймете, почему тестирование AI существенно отличается от классического QA

- Узнаете основные типы оценки AI-систем и сможете выбирать подходящий под конкретный сценарий

- Будете ориентироваться в пирамиде качества AI и понимать, на каких уровнях возникают ключевые риски

-

02 заняття06.05.2026 19:00

Архитектура AI-систем: что тестировать

- Научитесь декомпозировать AI-систему на компоненты и привязывать тесты к каждому из них

- Сможете четко различать ML-, LLM- и RAG-пайплайны и их зоны ответственности

- Сможете определять критические точки риска в архитектуре и использовать их для построения тестовой стратегии

-

03 заняття11.05.2026 19:00

Таксономия AI-фейлов

- Научитесь системно классифицировать AI-фейлы

- Узнаете реальные причины отказов моделей, LLM и систем в целом

- Сможете применять таксономию для анализа реальных инцидентов и предотвращения повторных сбоев

-

04 заняття13.05.2026 19:00

Метрики ML: когда они врут

- Научитесь выбирать метрики, реально отражающие качество модели

- Будете понимать ограничения accuracy и других стандартных метрик

- Сможете анализировать результаты моделей в разрезе сегментов и бизнес-влияния

-

05 заняття18.05.2026 19:00

Регрессионное тестирование моделей

- Сможете построить процесс контроля качества при каждом обновлении модели

- Научитесь корректно сравнивать версии моделей с учетом вариативности данных и статистической значимости

- Будете понимать, как интерпретировать результаты A/B-тестов в продакшене

-

06 заняття20.05.2026 19:00

Качество данных и обнаружение дрейфа

Результат:

- Научитесь выявлять проблемы с качеством данных еще до того, как они окажут влияние на модель

- Сможете различать типы дрейфа и OOD-случаи и использовать их как сигналы риска

- Освоите практические инструменты для мониторинга качества данных во времени

-

07 заняття25.05.2026 19:00

Специфика тестирования LLM

Результат:

- Разберетесь с недетерминизмом LLM и научитесь учитывать его во время тестирования

- Сможете тестировать работу моделей с длинным контекстом и streaming-ответами

- Научитесь настраивать локальную и API-среду для воспроизводимых тестов

-

08 заняття27.05.2026 19:00

Тестирование промптов и генеративного поведения LLM

- Научитесь строить тестированные и версионированные промпты вместо ручных экспериментов

- Сможете создавать эталонные наборы для генеративных задач

- Будете проверять стабильность, корректность и структурированность ответов LLM

-

09 заняття01.06.2026 19:00

Тестирование многошаговых диалогов

- Научитесь проектировать сценарии тестирования сложных multi-turn диалогов

- Сможете проверять сохранение контекста, памяти и логической последовательности ответов

- Будете выявлять типичные проблемы чат-ботов в долгих разговорах

-

10 заняття03.06.2026 19:00

Метрики и автоматизированная оценка LLM

- Научитесь объективно оценивать качество LLM с помощью разных типов метрик

- Сможете комбинировать эталонные и безэталонные подходы в зависимости от задачи

- Будете контролировать стабильность ответов и корректность структурированных выходов

-

11 заняття08.06.2026 19:00

Многоязычное и украиноязычное тестирование

Результат:

- Научитесь тестировать LLM с учетом специфики украинского языка

- Сможете обнаруживать суржик, русизмы, ошибки склонения и code-switching

- Построите специализированные eval-наборы для украиноязычных и многоязычных сценариев

-

12 заняття10.06.2026 19:00

Архитектура RAG и точки отказов

Результат:

- Научитесь находить, на каком этапе RAG-системы возникают ошибки

- Будете понимать типичные причины галлюцинаций в RAG

- Сможете формировать тестовые гипотезы для улучшения retrieval и chunking

-

13 заняття15.06.2026 19:00

Метрики RAG и оценка

Результат:

- Научитесь измерять качество RAG-системы от поиска до финального ответа

- Сможете интерпретировать метрики контекста, поиска и генерации

- Будете проводить полноценную end-to-end оценку RAG

-

14 заняття17.06.2026 19:00

Выявление и уменьшение галлюцинаций

- Научитесь системно выявлять галлюцинации, а не только фиксировать их постфактум

- Сможете проверять правдивость утверждений и корректность цитирований

- Будете проектировать негативные сценарии и механизмы безопасного отказа

-

15 заняття24.06.2026 19:00

Безопасность LLM и Red-Teaming

- Научитесь проводить red-teaming AI-систем по понятной методологии

- Сможете выявлять prompt-инъекции, jailbreak-атаки и риски утечки данных

- Будете формировать структурированные отчеты с рисками и рекомендациями

-

16 заняття29.06.2026 19:00

Предвзятость, справедливость и объясняемость

- Научитесь выявлять разные типы предвзятости в AI-системах

- Сможете использовать инструменты объясняемости для анализа решений моделей

- Будете балансировать между точностью, справедливостью и стабильностью

-

17 заняття01.07.2026 19:00

Модульное и интеграционное тестирование для AI

- Научитесь писать unit- и integration-тесты для AI-компонентов

- Сможете совмещать детерминистические и вероятностные проверки

- Будете использовать snapshot testing и mocking для стабильных тестов

-

18 заняття06.07.2026 19:00

Обзор фреймворков оценивания

- Научитесь проектировать масштабируемые системы оценки AI

- Поймете жизненный цикл эталонных датасетов

- Сможете применять eval-driven подход для контроля регрессии

-

19 заняття08.07.2026 19:00

CI/CD и мониторинг AI-систем

- Научитесь интегрировать тесты AI в CI/CD-пайплайны

- Сможете настраивать quality gates и блокировать рисковые деплои

- Будете контролировать деградацию качества в продакшене

-

20 заняття13.07.2026 19:00

Продуктивность и контроль затрат LLM в продакшене

Результат:

- Научитесь читать и интерпретировать latency и cost-метрики

- Сможете выявлять регрессионный рост затрат

- Оцените влияние архитектурных решений на продуктивность

-

21 заняття15.07.2026 19:00

Протоколы человеческой оценки (Human Evaluation)

- Научитесь проектировать корректные процессы человеческой оценки

- Сможете работать с метриками согласованности аннотаций

- Будете интегрировать human-in-the-loop как часть AI-систем

-

22 заняття20.07.2026 19:00

Проектирование процесса AI QA

- Научитесь строить AI QA как часть продуктового процесса

- Сможете создавать test-планы и чек-листы с учетом рисков

- Будете эффективно коммуницировать результаты оценки со стейкхолдерами

-

23 заняття22.07.2026 19:00

Роль AI QA инженера и защита курсовых работ

- Представите собственную систему тестирования AI (LLM чат-бот, RAG-система или ML-классификатор) с автоматизированными eval-наборами и метриками

- Получите фидбек от лектора и рекомендации по развитию в сфере

регистрация

Пройдите комплексное обучение тестированию AI моделей и постройте полноценную систему: от анализа рисков до мониторинга в продакшене.