- < онлайн-курс >

- < 18 занятий >

- < Старт 07.12 >

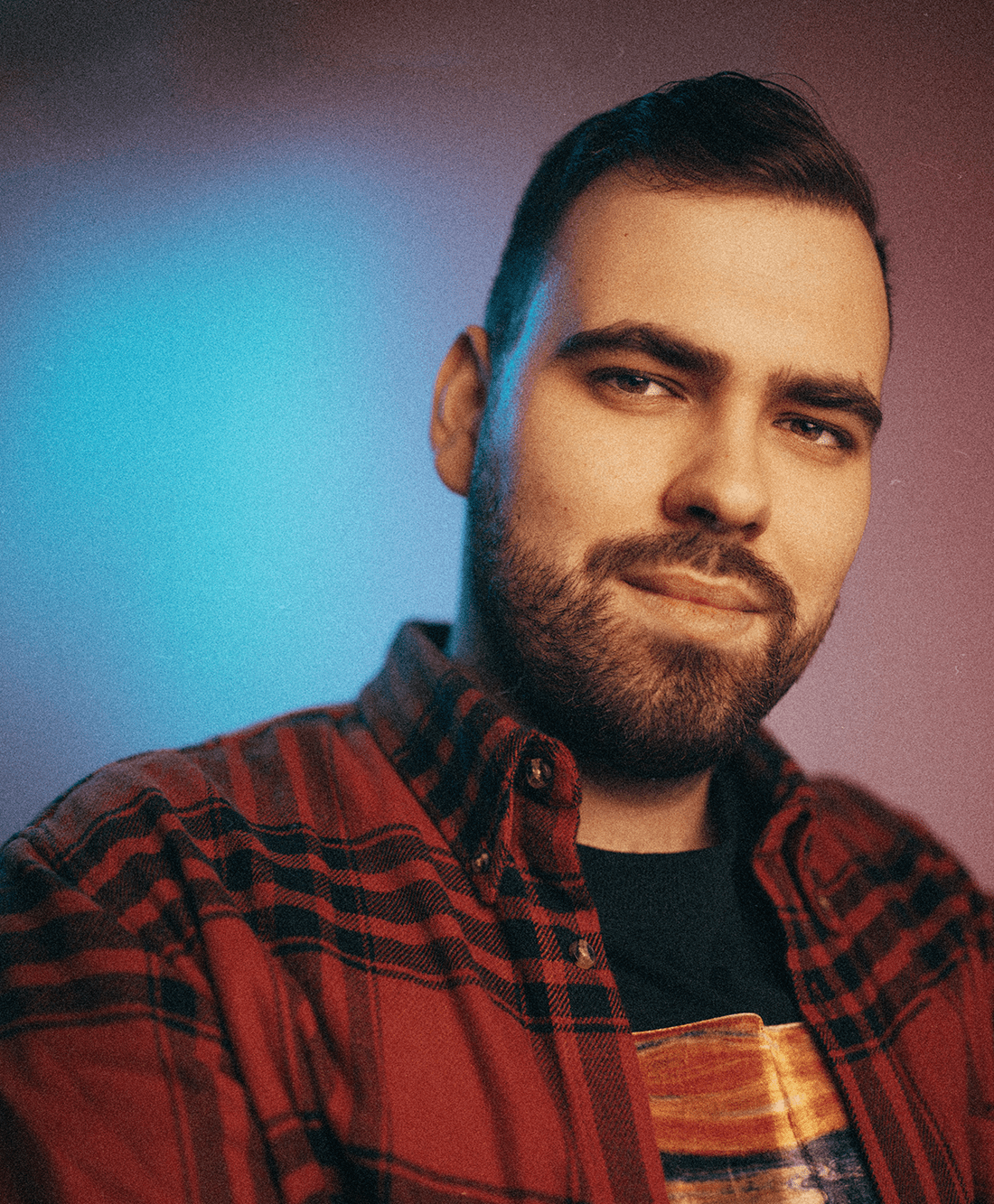

Антон Бондарь

Big Data Consultant в Cognizant

о курсе

Вы детально изучите все этапы обработки данных и разберете необходимые инструменты для работы с ними, научитесь строить ETL-системы и проектировать хранилища данных.

- Эквивалент 1,5 лет самостоятельного обучения

- 6 главных инструментов для работы DE

- Реальный проект в ваше портфолио

специализация курса

- Software/ SQL/ ETL Developer

- Data Scientist/ Data Analyst

- Data Engineer (beginner)

- Python

- ⟶ базовые операции, работа с переменными и структурами данных.

- SQL

- ⟶ выборка и фильтрация данных, объединение наборов данных.

7 декабря — 3 марта

18 занятий (по вторникам и четвергам)

лектор

Антон Бондарь

Big Data Consultant в Cognizant

- Консультирует компании из списка Fortune 500 (DXC Technology, AVI-SPL)

- Более 6 лет опыта работы с Big Data

- Занимался построением Data Platform в AVI-SPL, работал над технологией прогнозирования отказов техники на основе больших данных

- Работал с Big Data в DXC Automotive, занимался подготовкой данных для платформы сбора и обработки показателей автопилотов

Программа

-

- занятие 1

- онлайн 07.12 в 19:00

Введение в Data Engineering

Узнайте всё, что вы хотели о профессии Data Engineer: цели, направления, задачи, обязанности и функция в команде. Сравните Data Engineer vs Big Data Engineer. Ознакомьтесь с технологиями, с которыми вы будете работать во время курса. Поймите, какие задачи решает конкретная Big Data технология.

-

- занятие 2

- онлайн 09.12 в 19:00

Python для Data Engineering

Научитесь работать с разными структурами данных: string, list, tuple, set, dictionary. Начните загружать данные из внешних источников с помощью Python. Узнайте специфику работы с модулями Python: import и relative import модулей.

-

- занятие 3

- онлайн 14.12 в 19:00

SQL для Data Engineering

Узнайте, для чего используется SQL в Big Data. Научитесь объединять наборы данных при помощи SQL: JOIN, UNION, EXCEPT. Начните использовать SQL для аналитических запросов: аналитические функции, группирование данных, оконные функции. Поймите, как писать быстро-выполняющийся SQL.

-

- занятие 4

- онлайн 16.12 в 19:00

Аналитические базы данных

Выявите различия между OLTP и OLAP системами. Поймите техническую реализацию системы управления баз данных, предназначенных для аналитики. Научитесь описывать структуру базы данных при помощи ER-модели для ее будущего конструирования (Crow’s foot notation).

-

- занятие 5

- онлайн 21.12 в 19:00

Проектирование хранилищ данных

Узнайте, какое назначение хранилищ данных и какие существуют подходы к их проектированию. Научитесь проектировать (строить) хранилища данных. Освойте навык “представление данных в виде витрин”. Разберите примеры существующих хранилищ данных.

-

- занятие 6

- онлайн 23.12 в 19:00

Передача данных между системами. Часть 1

Спроектируйте ETL решение. Поймите, как передавать данные между системами. Научитесь извлекать данные из внешних источников, трансформировать и очищать.

-

- занятие 7

- онлайн 13.01 в 19:00

Передача данных между системами. Часть 2

Научитесь создавать, запускать и мониторить ETL при помощи Apache Airflow. Начните описывать ETL процессы, используя Directed Acyclic Graph. Напишите свой оператор Airflow для доступа к API. Подключитесь к внешним источникам данных с помощью Apache Airflow.

-

- занятие 8

- онлайн 18.01 в 19:00

Распределенные вычисления. Лекция

Разберитесь с понятием распределенных систем и вычислений. Узнайте, какие задачи они решают и какие готовые решения уже существуют. Выявите отличия распределенных систем от обычных, разберите их преимущества и недостатки. Поймите, что означают свойства распределенных систем и ограничения распределенных систем в САР-теореме для вашей работы. Узнайте, на что стоит обратить внимание при построении распределенных систем и чем можно пожертвовать при решении конкретной задачи.

-

- занятие 9

- онлайн 20.01 в 19:00

Экосистема Hadoop для распределенной работы с файлами

Научитесь пользоваться экосистемой Hadoop. Узнайте, в чем предназначение каждой технологии в рамках экосистемы Hadoop. Изучите альтернативы Hadoop. Начните использовать Hadoop Distributed File System.

-

- занятие 10

- онлайн 25.01 в 19:00

Распределенная файловая система (HDFS)

Научитесь работать с распределенной файловой системой Hadoop. Ознакомьтесь со спектром решаемых задач. Изучите внутреннюю архитектуру HDFS и особенности её реализации. Научитесь управлять файлами, загружать, выгружать данные, администрировать кластера при помощи HDFS.

-

- занятие 11

- онлайн 27.01 в 19:00

BigData архитектуры

Освойте технологию MapReduce для параллельных вычислений над большими наборами данных в компьютерных кластерах. Изучите задачи, которые решаются с помощью MapReduce. Научитесь анализировать большие объемы данных с использованием MapReduce

-

- занятие 12

- онлайн 01.02 в 19:00

Распределенные вычисления в оперативной памяти (Apache Spark)

Начните обзор технологии Apache Spark, выявите её отличие от MapReduce. Поймите, почему Apache Spark флагманская технология в мире BigData. Узнайте, какие задачи решает Apache Spark. Используйте технологию Apache Spark для организации больших данных.

-

- занятие 13

- онлайн 03.02 в 19:00

Работа со структурированными данными при помощи SparkSQL. Часть 1

Начните знакомство со SparkSQL — одним из синтаксисов Apache Spark. Научитесь загружать данные в Spark. Изучите работу Spark со внешними источниками данных. Совершите трансформации над структурированными данными при помощи SparkSQL.

-

- занятие 14

- онлайн 08.02 в 19:00

Работа со структурированными данными при помощи SparkSQL. Часть 2

Начните выгрузку данных из Spark. Научитесь проводить аналитику на структурированных данных в Spark.

-

- занятие 15

- онлайн 10.02 в 19:00

Оптимизация выполнения задач в Apache Spark

Поймите, как написать эффективный код и ускорить обработку больших данных в Apache Spark. Научитесь выявлять основные проблемы производительности Spark, устраните их. Организуйте данные в кластере Apache Spark.

-

- занятие 16

- онлайн 15.02 в 19:00

Потоки данных в Apache Spark

Поймите, чем отличается обработка потоковых данных от статичных. Научитесь обрабатывать потоки данных с помощью Spark Streaming. Разберите пример программы по анализу потоковых данных.

-

- занятие 17

- онлайн 17.02 в 19:00

Подведение итогов

Объедините все полученные знания. Создайте data platform. Сделайте обзор полного цикла подготовки и реализации проекта. Начните подготовку к курсовому проекту.

-

- занятие 18

- онлайн 03.03 в 19:00

Защита курсового проекта

Получите тему курсового проекта. Ознакомьтесь с форматом работы. Выполните ряд обязательных требований для реализации проекта. Успешно защитите его.

регистрация

после курса вы сможете:

-

1

Освоите инструменты Hadoop, Apache Airflow, Apache Spark, SparkSQL, HDFS и MapReduce.

-

2

Научитесь хранить и обрабатывать огромные массивы данных.

-

3

Построите собственную Data Platform, которые способна масштабироваться.

What if … :

- 1. ... курс не понравился — можно вернуть деньги.

- 2. ... не подходит график занятий — уточните, когда будет следующий поток.

- 3. ... вы пропустили занятия — сохраняется запись.